Ben ritrovati. Ecco a voi la terza ed ultima parte dell’analisi di Nessuno sui nuovi processi produttivi GPU. Qui la prima, qui la seconda. Come sempre grazie della pazienza e soprattutto grazie a Nessuno per il suo contributo.

#2.4 Polaris 10

Alla fine del mese di Giugno arriva il giorno dell’esame di maturità anche per AMD. Il 29 è il giorno della pubblicazione dei test condotti dai vari siti specializzati alle schede RX480 e RX470 basate su Polaris 10. È il momento di dare un volto alle slide, agli annunci, alle mezze verità e alle tante speranze che sono state alimentate con saggezza per 6 lunghi mesi, da quella prima slide in cui compariva un Polaris 11 super efficiente e competitivo. E’ arrivato il momento in cui i test realizzati con le più disparate configurazioni, giochi e applicativi riveleranno anche quei numeri che AMD non ha mai dichiarato, lasciando intendere, ma non comprendere. È il momento della verità raccontata dalla realtà dei fatti, non quella delle test selezionati condotti in casa e delle belle slide colorate.

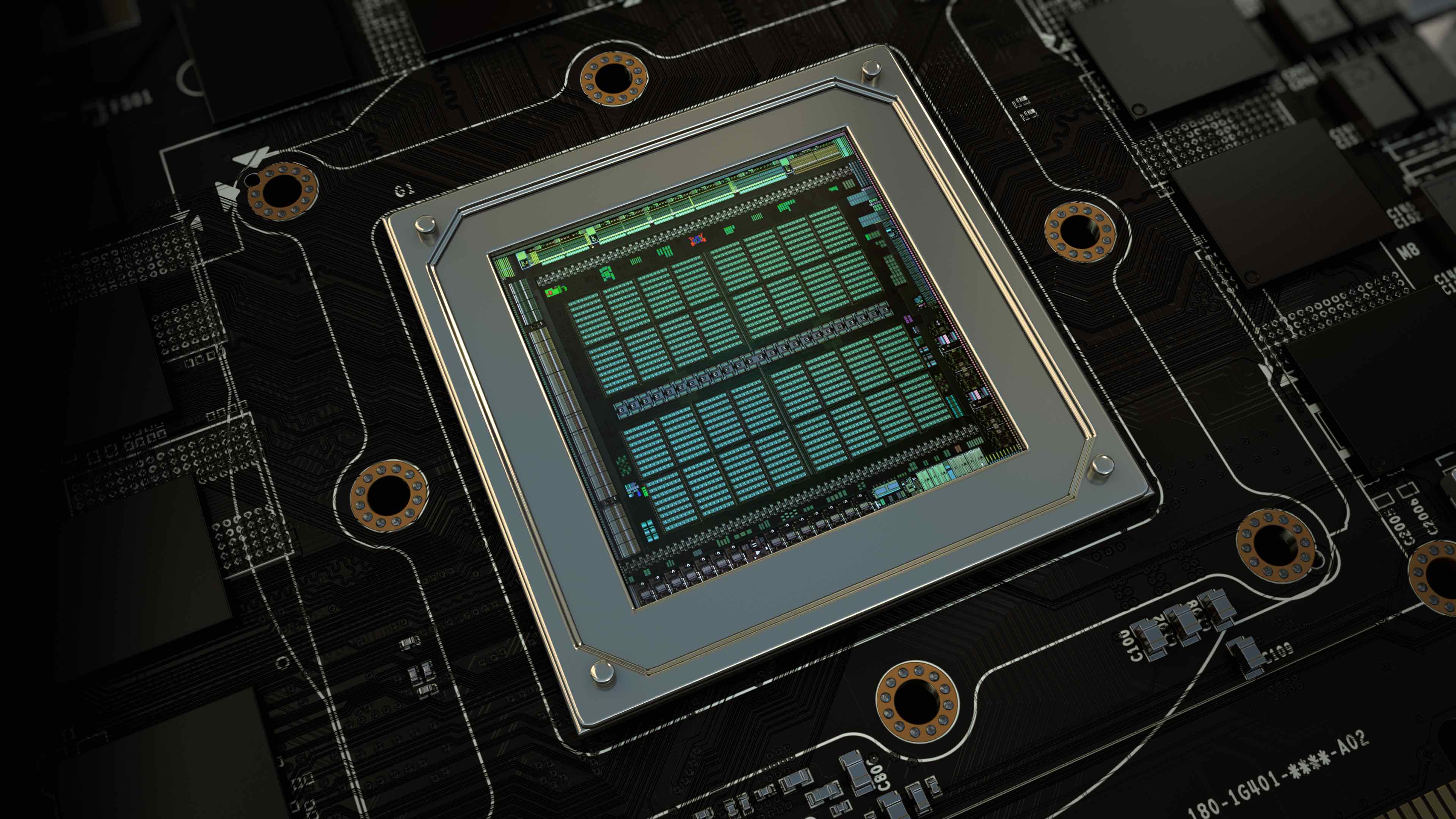

Cominciamo con un confronto tra le caratteristiche tecniche delle schede (con chip completo) presentate dalle due rivali:

[2.4.1 – Tablella comparativa]

[2.4.1 – Tablella comparativa]

[2.4.2 – La 1080 è quella in fondo al grafico, se non l’avete trovata]

[2.4.2 – La 1080 è quella in fondo al grafico, se non l’avete trovata]

I confronto è impietoso.

L’unico punto in cui AMD non è in svantaggio rispetto al GP104 è la dimensione del chip che suggerisce che le due soluzioni sono destinate a fasce diverse del mercato, sebbene secondo tutto quello che aveva fatto semi intuire AMD non sarebbe dovuto essere proprio così, con il suggerimento che Polaris 10 avrebbe potuto in qualche modo dar fastidio al GP104, sopratutto grazie alla sua migliorata efficienza energetica rispetto a quel GCN che da quel punto di vista molto aveva da recuperare.

Una volta digeriti i numeri, spente molte illusioni, ritornati con i piedi per terra e quindi ridimensionati quelli che dovevano essere i risultati di Polaris, molte cose rimangono in sospeso, non ultima il comprendere la strategia annunciata da AMD per combattere la rivale. Ma più nell’immediato tornano in mente le slide mostrate solo poche settimane prima: che voleva dire con quel CrossFire che andava più della 1080 con il 50% di carico? Qui si vede che Polaris se funziona tutto completamente forse arriva al 60% delle prestazioni del GP104.

E la slide in cui compariva una efficienza del 2.5x rispetto a GCN? Vediamo che Polaris è migliore di GCN ma molto lontano dal quel 2.5x annunciato. Neanche 2x nonostante il nuovo PP. E non arriva nemmeno a rispettare la slide di AMD che indicava un consumo <150W, dato che in realtà ne consuma più di 160 (e la versione reference sfora le specifiche PCIe assorbendo più dei 66W dallo slot della scheda madre). Ne risulta che la 480 ha efficienza energetica persino inferiore alla vecchia 980 a 28nm, che ha lo stesso consumo ma è leggermente più veloce.

Le prestazioni sono migliorate rispetto a GCN esattamente in proporzione all’aumento di frequenza e tutte le nuove caratteristiche di Polaris descritte nelle slide non sembrano aiutino a renderla nemmeno il 5% più veloce a parità di clock. Se Pascal sembra uno shrink migliorato di Maxwell, Polaris sembra solo uno shrink di GCN senza alcun vantaggio architetturale.

In assoluto le prestazioni della 480 sono inferiori a quelle della 980 e della 390X (e addirittura della ormai vetusta 290X).

Non si capisce quindi come l’azienda possa tenere testa a NVIDIA con questa soluzione che AMD stessa dice sarà il meglio che ha da offrire per i successivi mesi (almeno 6, in verità sappiamo che saranno almeno 10) .

Tutto questo si riflette ovviamente nel prezzo della scheda appena presentata. Piazzata a circa metà del prezzo di lancio della 980, obbliga NVIDIA, dopo oltre 2 anni, ad abbassare il prezzo delle sue soluzioni Maxwell (970/980) a livello di questa. Però le soluzioni NVIDIA sono basate su una GPU di quasi 400mmq, che seppur realizzate con un PP a 28nm maturo hanno un certo costo, quindi al prezzo della nuova scheda equivalente di AMD (prezzo che comunque non raggiungeranno mai) diventano molto anti economiche per l’azienda.

Il problema per NVIDIA è comunque momentaneo, giusto il tempo di svuotare i magazzini di 980/979 a prezzo (neanche tanto) ridotto, dato che il GP106 è pronto e manca solo inscatolarlo e infatti il mese successivo rilascia la GTX1060 che va a scontrarsi direttamente con la nuova 480.

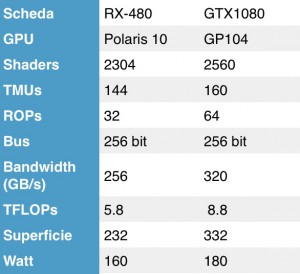

Confrontiamo quindi i due chip che competono nella stessa fascia mainstream del mercato:

[2.4.3 – Tabella comparativa]

[2.4.3 – Tabella comparativa]

[2.4.4 – Grafico riassuntivo di TechPowerUp delle prestazioni della 1060 a 1080p]

[2.4.4 – Grafico riassuntivo di TechPowerUp delle prestazioni della 1060 a 1080p]

[2.4.5 – Grafico riassuntivo di TechPowerUp dei consumi della 1060]

[2.4.5 – Grafico riassuntivo di TechPowerUp dei consumi della 1060]

Come si comporta questa ultima scheda di NVIDIA?

Per prestazioni è praticamente una copia solo leggermente migliore del GM204 montato sulla 980, con un piccolo miglioramento dei consumi (120W vs 165W), ma sopratutto è grande il 50% in meno essendo solo di 200mmq vs i 398mmq del GM204. Con un numero di risorse di calcolo inferiore a quelle del GM204, è evidente che NVIDIA ha puntato tutto sull’aumento di frequenze con conseguente diminuzione dell’efficienza, che infatti non è il 2x promesso, ma con vantaggio dei costi per un chip più piccolo, compromesso possibile per quanto detto prima sulle capacità del PP di migliorare le prestazioni tramite frequenza invece che solo per aumento dei transistor.

Il confronto rimane impietoso se consideriamo che la 480 non riesce a superare le prestazioni della 1060 se non di poco in quei giochi che sono stati ottimizzati per l’architettura AMD.

Il grafico di TechPowerUp descrive malinconicamente la situazione. Che non solo non è migliorata da GCN vs Maxwell, ma è persino peggiorata se possibile.

AMD ancora una volta insegue nelle due caratteristiche principali che definiscono la bontà (e quindi il margine ottenibile) di una soluzione: prestazioni/area e prestazioni/watt.

Come abbiamo già detto prima, il primo rapporto definisce il margine di guadagno necessario per fare i soldi che mancano alle casse di AMD, il secondo la possibilità di far adottare la soluzione in sistemi mobile come i notebook, che ormai assorbono il 50% delle GPU discrete.

Come con GCN, il confronto con le soluzioni della concorrenza indicano che AMD avrà un basso margine e che le sue soluzioni non faranno quel botto sperato nel mercato mobile.

I prezzi delle schede NVIDIA rimangono così altissimi e persino la GTX1060 da 6GB viene venduta con un prezzo premium rispetto alla RX480. E’ evidente che AMD ha fallito in quella rivoluzione che voleva far abbassare i prezzi delle schede video riportandoli a quelli “popolari” di una volta. Senza un prodotto alternativo convincente, con il mercato che continua a preferire una spesa maggiore per un prodotto migliore, i prezzi della nuova generazione non solo non sono diminuiti, ma addirittura si sono alzati, sintomo che non c’è una ritornata competitività tra le due aziende.

Se a questo punto vedete la situazione di AMD non proprio rosea per aver sul mercato una GPU contro le 2 di NVIDIA (tralasciando il GP100 destinato ad altro mercato completamente) che coprono una fascia di mercato ben più ampia, con una seconda GPU più piccola in arrivo e quindi destinata a fascia bassa dal margine ancora più basso, non avete visto ancora tutto. Infatti abbiamo l’affondo di NVIDIA che presenta a sorpresa solo pochi giorni dopo la GTX1060 il GP102, GPU la cui realizzazione era tra i rumor ma che molti non credevano sarebbe mai stata realizzata per via della sua presumibile inutilità (NVIDIA già conduce il mercato della fascia alta senza davvero alcun rivale e già impone i prezzi che meglio crede). Mai però sottovalutare l’ego del CEO NVIDIA!

Questa GPU è praticamente la versione per il mercato consumer del GP100, epurato delle unità per il calcolo FP64, di quelle per il calcolo FP16, della interfaccia proprietaria nvlink e del controller di memoria HBM sostituito da quello per memorie GDDR5(X) con bus da 384bit. Il risultato è una GPU di “soli” 471mmq (poco più grande di Hawaii tanto per fare un paragone con una GPU che è ancora in vendita) che ha capacità di calcolo (sulla carta) il 25% superiori a quelle del GP104 (11TFLOPS vs 8.8TFLOPS) e un consumo di 250W quando abbinato a 12GB di memoria GDDR5X a 10GHz effettivi. Destinazione, come ovvio, la nuova Titan X (stesso nome della vecchia ma senza il prefisso GeForce). Per NVIDIA è un altro modo di diminuire i costi (471mmq contro i 601mmq del “vecchio” GM200) e di alzare i margini in una fascia in cui la concorrenza non c’è.

La concorrenza in questo mercato è infatti praticamente nulla e NVIDIA ne approfitta in attesa di quella che dovrebbe essere la nuova GPU performante di AMD, Vega, che in teoria con l’uso della HBM2 (e quindi dei costi associati) dovrebbe inserirsi in questa fascia.

Infine, la mossa di AMD di rilasciare Polaris 11 a conclusione delle proprie soluzioni create prima di Vega è annientata da NVIDIA che cala anche il GP107 (che presenta una curiosità che vedremo in seguito).

Lo scenario è abbastanza desolante e i prezzi sul mercato riflettono la cosa.

NVIDIA ha un chip di 332mmq che vende ad un prezzo superiore rispetto al vecchio GM200 (da 601mmq). Il suo chip da 200mmq, il GP106, va quanto, se non meglio, di Polaris 10 da 232mmq. Il suo chip da 132mmq, il GP107, batte senza se e senza ma Polaris 11 consumando sempre meno (e questo è un problema per il mondo mobile a cui Polaris 11 era destinato).

La fortuna di AMD a questo punto si chiama “avidità”, e NVIDIA ne ha tantissima. Il risultato è un mercato completamente sotto il controllo di quest’ultima che volendo fare più margini possibile evita di schiacciare con i prezzi le soluzioni più costose e meno performanti della concorrenza. È evidente infatti che NVIDIA potrebbe vendere il GP106 ad un prezzo inferiore a quello praticato per Polaris 10 da AMD, portando quest’ultima ad annullare completamente il già esiguo margine. Ma, come dimostrato dai risultati dell’ultima trimestrale (conclusa a fine Settembre per AMD e a fine Ottobre per NVIDIA), NVIDIA persegue l’obbiettivo di realizzare il massimo profitto senza voler “uccidere” la concorrenza (senza la quale sorgerebbero problemi di anti trust rimanendo l’unica compagnia a operare nel mondo delle GPU discrete).

Questo è probabilmente uno scenario che non cambierà più fino all’arrivo di Vega nel Q1 2017 (aggiornamento… sembra che Vega sia posticipato al Q2).

La speranza è che Vega non faccia la stessa fine di Fiji che nonostante tutte le caratteristiche che mostrava sulla carta non è comunque riuscito a battere il GM200 ed è stato schiacciato nel prezzo da quest’ultimo. Se così sarà, sarà un bel problema per AMD visto che fino alla prossima generazione, prevista nel 2018 con Navi non sembra avere altri assi nella manica.

Fin qui ho elencato i fatti in maniera più o meno cronologica con poche (spero) interpretazioni. Ora vediamo quali sono le nuove armi a disposizione dei contendenti con cui misurarsi per gli anni a venire, ovvero quali sono le condizioni del mercato che sono cambiate.

#3. The deafening sound of silence

All’annuncio di AMD riguardante Polaris 11 e i suoi presunti vantaggi rispetto a Maxwell NVIDIA non ha risposto in alcun modo. Sembrava non avere nulla da dichiarare, come qualcuno preso alla sprovvista da un annuncio shock imprevisto, alla stregua di un pugile preso con la guardia abbassata.

Ma che stava facendo in quelle settimane?

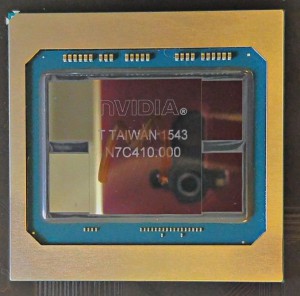

[3.1 – Immagine del GM200]

[3.1 – Immagine del GM200]

Guardate la data di produzione di questo GM200, segnata con il codice -1543 … anno 2015, 43 settimana. La 43^ settimana corrisponde alla terza settimana di Ottobre. Quindi mentre AMD sfornava i primi esemplari della minuscola Polaris 11 con la quale poi gongolarsi in slide poco realistiche (come i fatti hanno dimostrato), NVIDIA produceva in silenzio la sua mattonella da 610mmq destinata ad un mercato con margini impensabili per i prodotti AMD. Tanto che il suo primo annuncio riguardante Pascal è stato proprio dire che era a disposizione il GP100, che è già il massimo producibile (per dimensioni) con il nuovo PP, ai partner selezionati, non un mezzo confronto tra la sua GPU mignon appena sfornata (e lontana 8 mesi dalla messa in vendita) e una castrata della generazione precedente.

Forse la differenza di preparazione ad affrontare il mercato con i propri prodotti in toto si può misurare da questi due tipi di approcci. Negli ultimi anni, dopo la catastrofe Fermi, NVIDIA non ha più fatto alcun annuncio prematuro dei suoi prodotti, limitandosi ad annunci pubblici qualche settimana prima della reale messa in vendita dei prodotti. Talvolta sforna soluzioni senza dare alcun preavviso (come appunto per il GP100 o come con la Titan X).

Il silenzio durante la prima apparizione di Polaris 11 e fino alla messa in vendita del GP104 evidenzia la differente disponibilità di mezzi e soluzioni tra le due aziende: per NVIDIA sembra che parlino i fatti e le prestazioni reali delle proprie schede rispetto alle dichiarazioni e i numeri delle innumerevoli slide di AMD. Il tutto credo sia dovuto al fatto che la concorrente di NVIDIA da qualche tempo è NVIDIA stessa e presentazioni troppo anticipate causerebbero danno ai propri prodotti in vendita e venduti senza particolare necessità di creare aspettative.

È una cosa da tenere in considerazione, perché potremo valutare quando il clima in casa NVIDIA cambierà e cominceranno a modificare la propria strategia.

Forse allora potremo realmente constatare che AMD è tornata a dare fastidio alla casa di SantaClara che per ora (e da diversi anni) domina il mercato senza scomporsi.